Mobileye 1 Mobileye 1

Prof. Amnon Shashua ist gleichzeitig President und CEO von Mobileye und Senior Vice President von Intel, das zeigt die enge Verbindung zwischen beiden Firmen. Mobileye beschäftigt sich mit dem gesamten

Spektrum vom Fahrassistenz bis zum vollen Autonomen Fahren. Mobileye, Sie erinnern sich vielleicht, das ist die Firma, mit der Tesla zunächst zusammengearbeitet hat. Die Trennung kam vermutlich nach

einem der ersten Unfälle mit Teslas, die ein wenig zu autonom unterwegs waren. Jetzt entwickelt Tesla allein weiter.

Die Anforderungen und Aufträge werden von Jahr zu Jahr zahlreicher und komplexer. 17,4 Mio. Chips hat man 2019 ausgeliefert und damit seit 2007 54 Mio. Fahrzeuge mit IQ-Chips ausgerüstet. Hier sollen nur

die größeren Herausforderungen erwähnt werden und wie Mobileye und Intel diesen begegnen. Kennzeichnend für die Situation sind immer wieder die Möglichkeiten jetzt und die in der Zukunft. Dort strebt man

ein System an mit nur einem gravierenden Fehler bei 10.000 Std. Fahrt.

Ist das schon an Verwegenheit kaum zu übertreffen, soll (für 5.000 Dollar) ein fix und fertiges Paket aus Sensorik, Kabeln und Auswertung geschnürt werden, das aus einem gewöhnlichen Konsumenten-Auto

ein selbstfahrendes macht, bei dem der/die Fahrer/in sich auf dem Rücksitz tummelt. Immer wieder kommt das schon früher einzuführende Robo-Taxi ins Gespräch, Ausstattung und Software nicht nur für die

Eigenentwicklung, sondern auch für andere Hersteller solcher Gefährte.

Soweit erst einmal die Visionen. Viel konkreter sind die nächsten geplanten Schritte. Da man vermutlich auch bei Mobileye bemerkt hat, dass der Schritt von Level 2 nach 3 ein ziemlich großer ist, favorisiert

man jetzt die '2+'. Soll heißen, dass zunächst einmal die Ausstattung angereichert wird. Statt nur einer Front-Kamera deren mehrere. Sie würden so ziemlich die kostengünstigste Sensorik für ein

Assistenzsystem überhaupt darstellen. Hinzu käme dann eine hochauflösende Karte. Damit könnte die relative Abwesenheit des/der Fahrers/in vom Fahrgeschehen auch auf mehrere Minuten ausgedehnt werden.

Und dann wieder die Weitsicht des Konzerns, das Erschließen neuer Geschäftsfelder rund um das Thema Mobilität und Software. Als Erstes kommt der Begriff 'Backoffice', also der Teil eines Unternehmens, der

nicht originärer Teil des Kerngeschäftes ist, sondern zu dessen Aufrechterhaltung dient. Und dann natürlich das Flottenmanagement und die Optimierung derselben. Wie weit sich das auch auf Taxi-Dienste und damit

den

Bereich von Uber bezieht, wird nicht vollständig geklärt.

Die Arbeit von Kameras wird erstaunlich genau beschrieben. Es beginnt mit den erzeugten Bildern, die mit nur 10 kByte pro Kilometer Fahrt zu einer Cloud geschickt und wohl dort weiter verarbeitet werden.

So ergeben schließlich alle Einsendungen ein hochauflösendes Bild. Erstaunlicherweise ist dann die Fahrbahn grün und man unterscheidet Markierungen und User der Straße besser. Letztere werden

schon einmal kategorisiert. Das haben wir auch schon oft gesehen, wenn dann so seltsame Kästchen darum gezeichnet werden.

Wichtig ist, dass man sich bei der Suche nach einem fahrbaren Weg nicht nur auf die gezeichneten Spuren verlässt, sondern im Prinzip sogar die Umgebung dafür auslotet. Deshalb auch die Idee, jede

vorhandene Kamera zu nutzen, auch z.B. solche, die ein Bild rund um das Auto erstellen. Dabei tauchen die physikalischen Grenzen der Straße auf. Durch intelligente Software werden dann

hoffentlich die Schienen von Straßenbahnen nicht mehr zur Spurführung herangezogen. Haben wir alles? Natürlich nicht, denn da ist ja noch wichtige Infrastruktur wie z.B. Verkehrsschilder und Ampeln.

Für ein sehr wichtiges Stichwort hält man die Redundanz. Die ist zum einen möglich, wenn Radar, Ultraschall, Laser und Lidar hinzukommen, übrigens ausdrücklich für Level 2+ nicht für nötig erachtet. Dann sollen die

verschiedenen Systeme getrennt ausgewertet und erst später verglichen werden. Da könnte dann z.B. entschieden werden, dass, wenn zwei Systeme zum gleichen Ergebnis kommen, man das zu einem

anderen kommende System ignoriert, zwei oder drei gegen eins.

Solch eine strenge Trennung hat man auch bei der Auswertung nur von Bildmaterial vor. Also jeweils eine bestimmte Folge von Algorithmen darauf loslassen und erst hinterher untereinander

vergleichen. Sie denken bitte immer noch an die unglaublich geringe Fehlerquote, die man sich letztlich zum Ziel gesetzt hat.

Kaum zu glauben, dass so eine riesige Ansammlung von Pixeln durchaus verschiedene Auswertungsmöglichkeiten von Grund auf hat. Da ist zunächst die Wahrnehmung der Punkte an sich. Da fällt mir wieder das

Gemälde von dem Bauermädchen mit Kuh im Kröller-Müller Museum (NL) ein. Die Kuh bestand aus Punkten. Man konnte sie nur erkennen, wenn man ein paar Schritte zurücktrat.

Man kann sich auch verstärkt an Farbrändern orientieren und daraus zuweisbare Formen erkennen. Der Mensch ist es gewohnt, seine 2D-Bilder in einer 3D-Welt einzuordnen. Mit mehreren Kameras kann man

3D direkt ermitteln und in einem solchen System auch Messungen durchführen. Dazu ein Sprung zur Technik. Es gibt schon Fahrzeuge, die mit sogenannten Trifokal-Sensoren ausgestattet sind. Recherche

dazu ergibt, dass eine Multifokallinse im Gegensatz zum bekannten Glas in einer Gleitsichtbrille den Nah- und Fernbereich ohne Änderung der Blickrichtung abdeckt. Entsprechend bewegliche Linsen können

heutzutage implantiert werden.

Greifen wir einen Bereich heraus, den der User im Verkehr. Z.B. wurde ein Bus mehrfach aufgenommen. Eine Möglichkeit der Erfassung wäre es, das schon erwähnte Einrahmen und der Vergleich mit

kategorisierten Bildern von Bussen. Ein anderer Algorithmus erfasst den Bus in seiner Umgebung als ein großes Teil je nach Bild dieses ganz einnehmend. Dann kommt die schon erwähnte grüne Farbe zum

Tragen, die alle auf ihr fahrenden Objekte abgrenzt. Allein schon der Vergleich mit anderen Verkehrsteilnehmern könnte den Bus identifizieren. Zusätzlich könnte man die Einzelheiten des Busses analysieren,

z.B. dass der Stadtbus im Gegensatz zu einem geschlossenen Lkw die Vorderräder ziemlich weit hinten angeordnet hat.

Es gibt noch mehr mögliche Bearbeitungen der Bilder durch Algorithmen, die uns Mobileye sicherlich nicht bis ins Detail aufdecken wird. Wichtig ist nur, dass jeder bis zu einem Ende geführt werden muss und

zwischenzeitlich keine Übernahme von Ergebnissen erfolgen darf. Zum Schluss kann man dann schauen welche Untersuchungen zu einem gemeinsamen Schluss gekommen sind.

Was wir schon an der grünen Farbe der Fahrbahn sehen, ist die Unterscheidung verschiedener Objekte durch Farbe. Erst kann ein System die Fußgänger noch nicht unterscheiden, während ihrer Bewegung

aber erhalten sie nach und nach unterschiedliche Farben. Es ist durch Software sogar möglich, bestimmte Haltungen von Menschen bezüglich ihrer Gliedmaßen zu erkennen. Da könnte dann ein hinter dem Ball

her laufbereites Kind von einem ruhig an Straßenrand stehenden abgesetzt werden.

Das dreidimensionale Vermessen mit Hilfe der Bilder verschiedener Kameras ist inzwischen z.T. besser als das, was das menschliche Auge zu leisten imstande ist. Es werden auch bewegliche Objekte als

Teile von Fahrzeugen erkannt, z.B. Türen. Das 3D-Bild muss nicht mehr zwangsläufig von einer Stereokamera gemacht werden. Erstaunlich, dass mit Hilfe mehrerer rundum angebrachter Kameras ein Modell

auch der weiteren Umgebung erzeugt werden kann.

Wenn das ausgereift ist, sollte es z.B. nicht mehr passieren, dass sich ein autonom fahrendes Auto hinter ein parkendes einordnet, sondern es durch das erweiterte Modell die Umgebung des Autos erkennt,

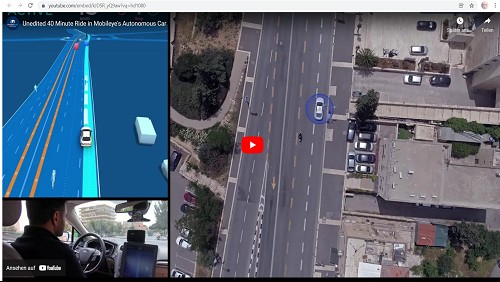

dass dieses parkt und nicht vor einer roten Ampel wartet. Zum Schluss noch das Video von einer 40-minütigen Fahrt durch Jerusalem. Den Verkehr dort stuft Professor Shashua als deutlich härter im

Vegleich zu Boston ein.

| Deutsche Untertitel möglich . . . |

kfz-tech.de/YAu14

|